Europska unija postavlja globalni standard za regulaciju umjetne inteligencije putem AI Act-a, prvog pravnog okvira koji se temelji na pristupu zasnovanom na riziku. Cilj ovog zakona je stvoriti sigurno, transparentno i etičko okruženje za razvoj i upotrebu AI tehnologija, istovremeno štiteći prava korisnika i potičući inovacije u sektoru.

Klasifikacija AI sustava prema riziku

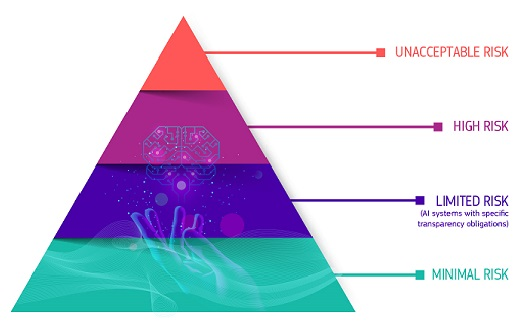

Jedan od ključnih elemenata AI Act-a je klasifikacija sustava prema razinama rizika:

- Neprihvatljiv rizik – Ovi sustavi su strogo zabranjeni jer predstavljaju ozbiljnu prijetnju ljudskim pravima i sigurnosti. Primjeri uključuju sustave koji manipuliraju ljudskom sviješću ili koriste biometrijsku identifikaciju u realnom vremenu za masovni nadzor.

- Visok rizik – Obuhvaća AI sustave u kritičnim sektorima poput zdravstva, prijevoza, obrazovanja i pravosuđa. Ovi sustavi podliježu strogim zahtjevima za transparentnost, ljudski nadzor, robusnost i sigurnost.

- Ograničen rizik – Sustavi s ograničenim rizikom moraju pružiti određeni stupanj transparentnosti. Na primjer, korisnici chatbotova moraju biti svjesni da komuniciraju s umjetnom inteligencijom, a ne s ljudima.

- Minimalan rizik – Većina AI aplikacija, uključujući videoigre i AI filtere za slike, spada u ovu kategoriju i ne zahtijeva posebne regulacije.

Posebna pravila za generativnu umjetnu inteligenciju

AI alati koji generiraju sadržaj, poput tekstova, slika i videozapisa, imaju dodatne obveze. Generativni AI modeli moraju jasno označiti sadržaj kao generiran AI-jem kako bi se spriječile dezinformacije. Deepfake sadržaj mora biti transparentan, a sustavi moraju osigurati tehničku dokumentaciju i sigurnosne mjere za sprječavanje zlouporabe.

Transparentnost i ljudski nadzor

Jedan od ključnih aspekata AI Act-a je zahtjev za ljudskim nadzorom nad visokorizičnim sustavima. Operateri sustava moraju osigurati da alati ostanu pod ljudskom kontrolom, osobito u kontekstima gdje bi odluke AI sustava mogle imati značajan utjecaj na ljudska prava, zdravlje i sigurnost.

Stupanje na snagu

Pravila za generativnu umjetnu inteligenciju i general-purpose AI sustave stupaju na snagu u kolovozu 2025. Ovo razdoblje omogućuje državama članicama i poduzećima da prilagode svoje operacije i procese kako bi bili u skladu s novim zahtjevima.

Zašto je AI Act važan?

AI Act ima dvostruku ulogu – zaštititi građane i korisnike AI sustava od potencijalnih rizika, a istovremeno stvoriti povoljno okruženje za razvoj inovacija. EU želi osigurati etički razvoj AI-ja, čineći ga sigurnim i korisnim za društvo, bez narušavanja temeljnih prava i sloboda.

Ovaj pravni okvir je važan korak prema izgradnji povjerenja u umjetnu inteligenciju i jačanju konkurentnosti europske AI industrije na globalnoj razini. Njime se također promiče suradnja između istraživačkih institucija, poduzeća i državnih tijela u svrhu razvoja inovativnih AI rješenja.

Za više informacija i detalje o pojedinim razinama regulacije posjetite službenu stranicu: EU Digital Strategy.

Za detaljniju pretragu i analizu pravnog okvira, korisnicima je na raspolaganju AI Act Explorer na sljedećoj adresi: https://artificialintelligenceact.eu/ai-act-explorer/. Ova platforma omogućuje lako pretraživanje i istraživanje sadržaja AI Act-a, uz korisne objašnjenja i poveznice na relevantne članke zakona.

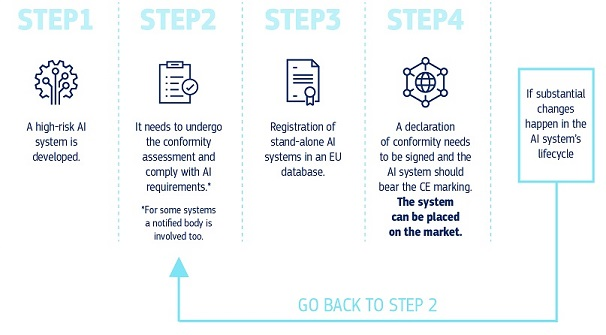

Next Steps: AI Act je stupio na snagu 1. kolovoza 2024. Njegova puna primjena slijedi dvije godine kasnije, 2. kolovoza 2026., uz nekoliko iznimaka:

- Zabrane i obveze vezane za AI pismenost primjenjuju se od 2. veljače 2025.

- Pravila o upravljanju i obveze za general-purpose AI modele vrijede od 2. kolovoza 2025.

- Pravila za visokorizične AI sustave ugrađene u regulirane proizvode imaju produljeni prijelazni rok do 2. kolovoza 2027.